Les limites de ChatGPT : entre crédibilité et hallucination

Au sommaire :

Le chatbot GPT ne fournit pas toujours des informations correctes. Ce n’est pas une découverte. Si certaines parties sont déconcertantes en ce qui concerne les connaissances inculquées à l’outil par les équipes d’OpenAI, d’autres sont simplement des inventions qui permettent à ChatGPT de répondre aux questions des utilisateurs.

Mais est-ce voulu ? L’outil est-il prévu pour inventer s’il ne sait pas ? Doit-on parler d’invention ou d’hallucination ?

Cela rend paradoxalement l’outil incroyablement utile pour la rédaction d’histoires ou parfois de fanfictions. Cependant, c’est une arme à double tranchant lorsqu’il s’agit de rédiger des documents pour des études ou pour le travail.

La réponse se situe entre le oui et le non. Disons qu’il ne crée pas, mais essaie de deviner ce qu’il ne sait pas. Un article de Ted Chiang dans le magazine New Yorker m’a mis sur la voie. Cela nous apprend non seulement comment les modèles de langage tels que GPT fonctionnent, mais aussi l’histoire de la gestion des données en informatique.

Une histoire d’imprimantes

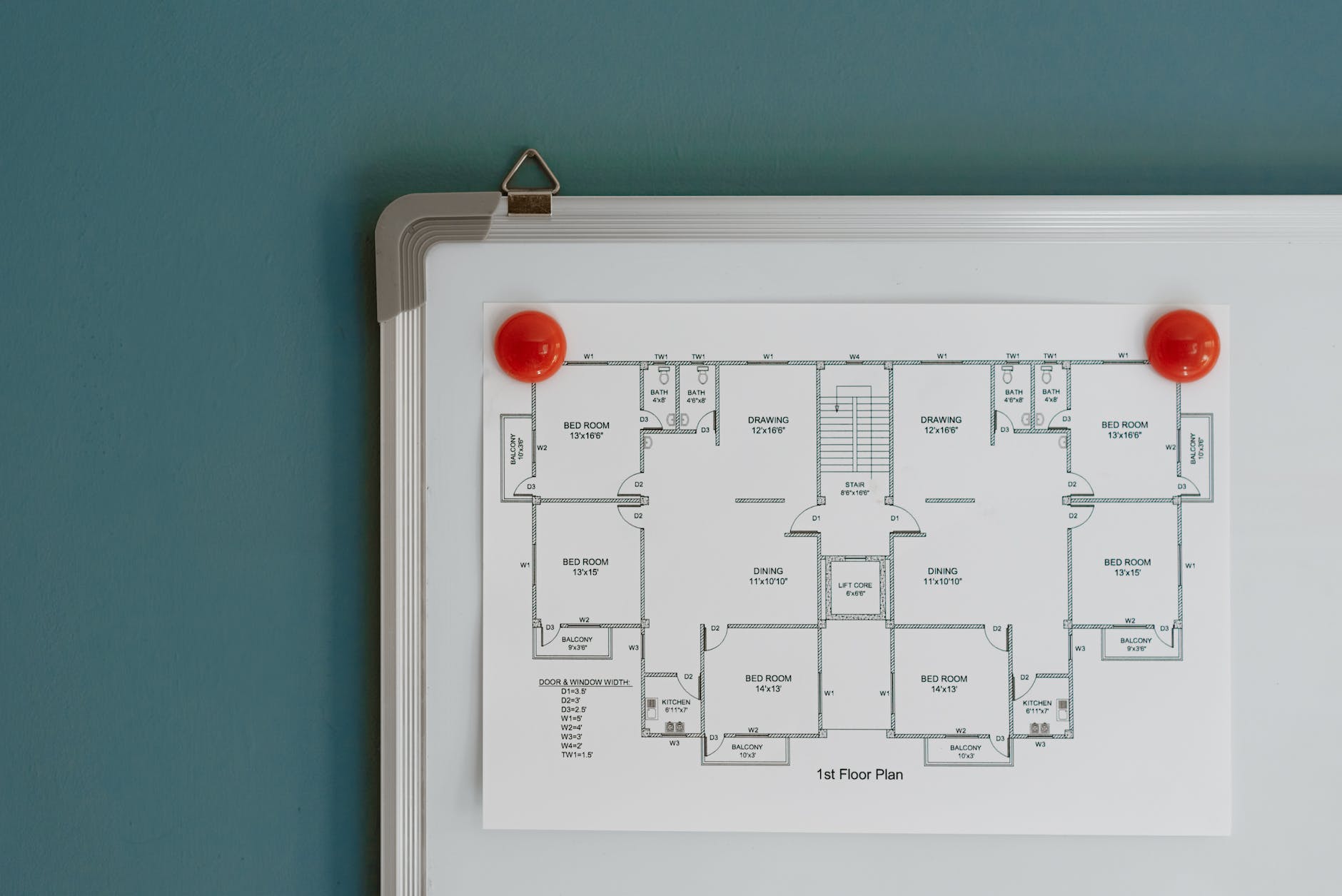

L’histoire racontée par Ted Chiang commence en 2013 en Allemagne. Des travailleurs d’une entreprise de construction ont remarqué quelque chose d’étrange à propos de leur photocopieur Xerox : lorsqu’ils ont copié le plan d’étage d’une maison, la copie différait de l’original de manière subtile mais significative.

Dans le plan d’étage original, chacune des trois pièces de la maison était accompagnée d’un rectangle spécifiant sa superficie : les pièces faisaient respectivement 14,13, 21,11 et 17,42 mètres carrés. Cependant, sur la photocopie, les trois pièces étaient étiquetées comme étant de taille de 14,13 mètres carrés.

L’entreprise a contacté l’informaticien David Kriesel pour enquêter sur ce résultat apparemment inconcevable. Ils avaient besoin d’un informaticien car un photocopieur Xerox moderne n’utilise pas le processus xérographique physique popularisé dans les années soixante.

Le processus xérographique, est une méthode d’impression qui utilise une charge électrostatique pour transférer de la poudre de toner sur du papier, créant ainsi une image. Bien que ce processus soit toujours utilisé dans certaines imprimantes et photocopieurs, il est de plus en plus remplacé par des technologies plus modernes telles que l’impression numérique.

La compression sans compassion

Au lieu de cela, il numérise le document numériquement, puis imprime le fichier image résultant. Combiné au fait que pratiquement tous les fichiers d’image numérique sont compressés pour économiser de l’espace, une solution au mystère commence à se suggérer.

Pour compresser un fichier, il faut l’encoder pour le rendre plus compact, puis le décoder pour le restaurer. Si le fichier restauré est identique à l’original, la compression est dite sans perte. Dans le cas contraire, il s’agit d’une compression avec perte, où certaines informations sont supprimées de manière irrécupérable.

Les fichiers texte et les programmes informatiques utilisent généralement la compression sans perte, tandis que la compression avec perte est courante pour les photos, l’audio et la vidéo, où une précision absolue n’est pas essentielle. Les artefacts de compression, tels que la pixélisation pour les images JPEG et MPEG, ou le son métallique des MP3 à faible débit binaire, ne sont perceptibles que lorsque les fichiers sont compressés très étroitement.

Le diable est dans la décompression

ChatGPT n’a pas accès à Internet et fournit des informations basées sur les données qu’il a apprises pendant son entraînement. Par conséquent, il dépend d’une base de connaissances importante mais pas illimitée. S’il ne détient pas les informations demandées, il tente de compenser cette lacune.

Lorsque ChatGPT ne sait pas répondre à une question, il essaie de deviner la réponse

De ce fait, ChatGPT utilise le même processus de décompression que pour les images ou la musique. Il part de données qu’il transforme en texte. La pixellisation que nous pouvons voir dans les images se transforme en « invention » dans les textes produits par ChatGPT. Parfois, c’est crédible et parfois, ce ne l’est pas. On dit alors qu’il hallucine en fournissant des informations à côté de la plaque.

En d’autres termes, lorsque ChatGPT ne sait pas répondre à une question, il essaie de deviner la réponse en utilisant les informations qu’il a déjà apprises. Cela peut parfois conduire à des réponses inventées qui ne sont pas tout à fait exactes. Néanmoins, ce processus est inévitable compte tenu de la manière dont les modèles de langage tels que GPT sont entraînés à partir de grandes quantités de données compressées.

La compréhension de ce phénomène est importante pour les utilisateurs de ChatGPT. Bien que l’outil puisse fournir des réponses fascinantes et précieuses, il est important de garder à l’esprit que ses capacités ont des limites. Les utilisateurs en être conscients et vérifier les informations importantes auprès de sources fiables.

ChatGPT vat-il évoluer ?

OpenAI a récemment dévoilé une version améliorée de son modèle génératif. GPT-4 est moins sensible à l’hallucination, mais il est encore loin d’être exempt de ce phénomène.

L’hallucination de ChatGPT est un phénomène intéressant qui montre à quel point les modèles de langage tels que GPT sont limités par les données compressées sur lesquelles ils sont entraînés. Bien que cela puisse conduire à des réponses inventées qui ne sont pas tout à fait exactes, ChatGPT reste un outil fascinant et précieux pour les utilisateurs. Cependant, il est important de garder à l’esprit ses limites et de vérifier les informations importantes auprès de sources fiables.

Si vous avez des commentaires ou des expériences à partager sur ChatGPT, n’hésitez pas à les partager ci-dessous. Comment faites vous pour ne pas vous laisser avoir par ces inventions ?